Ciencia y Tecnología

Reconocimiento facial: Los algoritmos sabrán quién eres aunque vayas tapado

En unas semanas se presentará un nuevo sistema capaz de identificar rostros aunque estén parcialmente cubiertos. Hay otros que pueden detectar hasta la inclinación sexual a través de una fotografía

En unas semanas se presentará un nuevo sistema capaz de identificar rostros aunque estén parcialmente cubiertos. Hay otros que pueden detectar hasta la inclinación sexual a través de una fotografía.

Desde encontrar trabajo, realizar una búsqueda en la web, encontrar el pasaje más económico para las vacaciones u obtener direcciones con el GPS, todo ello está dominado por los algoritmos.

Básicamente estos son recetas de cocina, instrucciones que llevan de A a B, siguiendo una serie de pasos. Los hay sencillos, como la receta de huevos fritos que apenas requiere una serie de pasos (Encender el fogón, poner la sartén, verter aceite, calentar aceite, echar el huevo, dorar la puntilla, sacar el huevo y mojar el pan) hasta otros que precisan cientos de pasos, como los de aquellas cocciones dignas de 12 estrellas Michelin. Pero todas siguen la misma estructura.

Lógicamente, cuanto más complejo es el algoritmo, más cualidades tendrá. Días atrás, la prensa se hizo eco de un robo en España en el que dos personas con el rostro cubierto tomaron como rehén a un joven que trabajaba en un salón de apuestas, para atracar el sitio. Un programa informático avanzado permitió identificar a los ladrones, pese a no ver sus rostros completamente. El software trabaja con un algoritmo que busca ciertas particularidades únicas: la distancia entre nuestros ojos, medidas de la nariz, tamaño de la frente, etc. Pese a su efectividad, se trata de una tecnología muy básica.

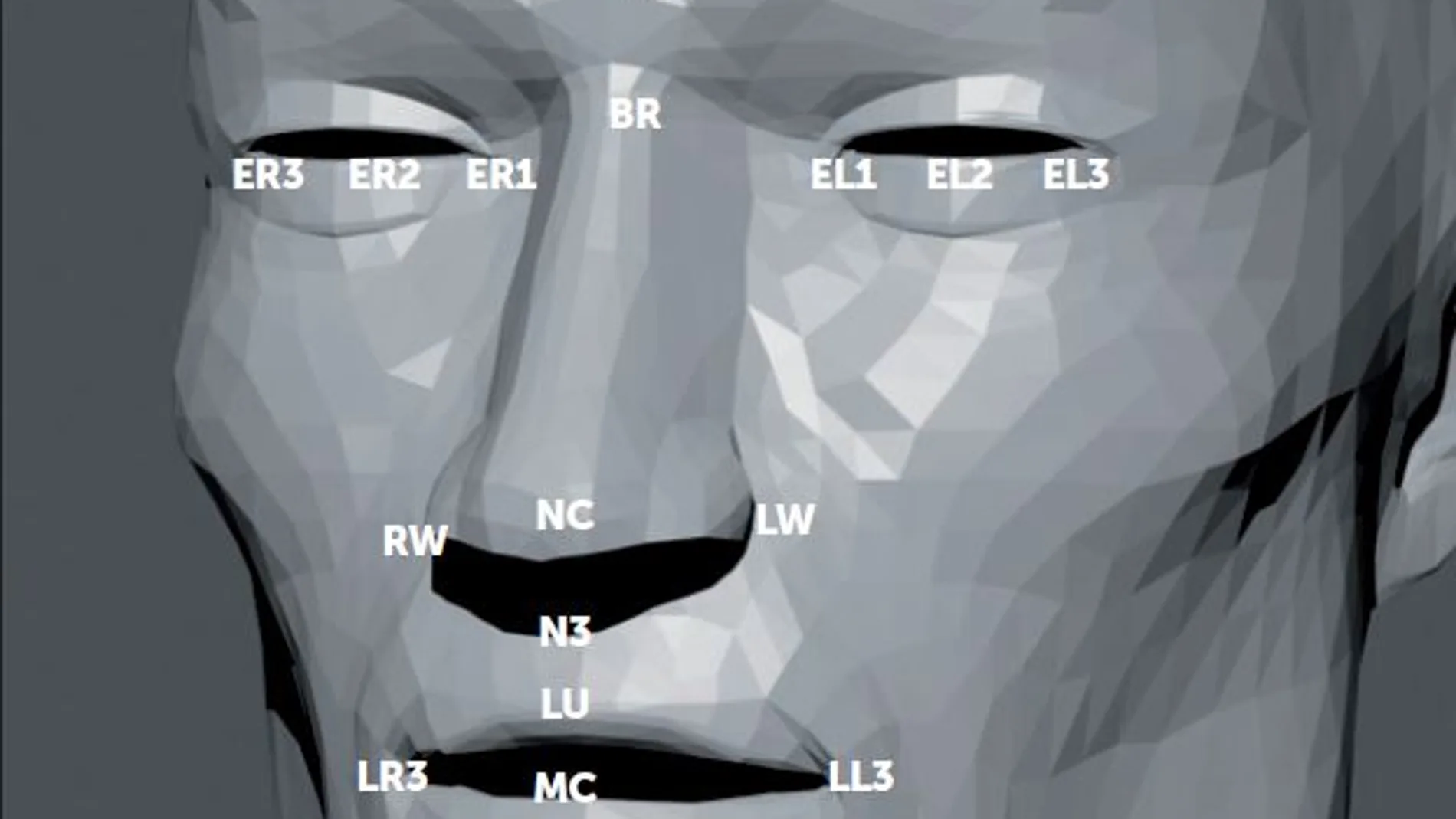

En menos de un mes se llevará a cabo la Conferencia Internacional de Sistemas de Visión Computarizadas. Allí se presentará un nuevo algoritmo capaz de identificar rostros parcialmente cubiertos. Lo que hace es identificar 14 puntos de nuestro rostro, desde diferentes ángulos y darle una identidad al resultado obtenido. En las pruebas de laboratorio, los expertos utilizaron hasta diez técnicas distintas para camuflar 500 retratos (desde gafas de sol, sombreros, pelucas o mascarillas), algunas de ellos tenían dos y hasta tres «elementos» distintos que podrían distraer, e hicieron que el algoritmo analizara las fotografías. En el 70% de los casos, el sistema supo identificar a la persona detrás de «la máscara».

Sin importar cuan avanzado sea el sistema o su eficacia, siempre se necesita una imagen, aunque sea parcial, del rostro... ¿O no? La verdad es que no. También es posible un alto grado de certeza si estamos de espaldas a la acción. Así lo ha demostrado un algoritmo experimental de Facebook que busca otras características, como el peinado, la ropa, las proporciones de nuestro cuerpo y hasta la pose. Para demostrar si valía para este tipo de tareas, los expertos, liderados por el director de Inteligencia Artificial en Facebook, Yann LeCun, hizo que el algoritmo analizara unas 40.000 imágenes públicas de Flickr, en algunas de ellas se veía el rostro y en otras estaba totalmente oculto. En un 83% de los casos el sistema acertó.

Nuestro rostro no solo nos diferencia de los demás en lo físico, también hay detalles más profundos y los algoritmos los pueden identificar igual que hacen con nosotros. Estos factores más ocultos son los que persigue el sistema Face2Gene, una tecnología que, analizando el rostro es capaz de ofrecer un diagnóstico de hasta 7.000 enfermedades genéticas poco habituales, como los síndromes Hajdu-Cheney, Kabuki, Sotos o Mowat-Wilson. Debido a su facilidad de uso y la velocidad con la que se obtiene un diagnóstico, mejora notablemente las posibilidades de tratamiento. Aunque solo está disponible para médicos.

Por si fuera poco esta tecnología también puede ser utilizada en modo «reverso»: para enviar señales que busquen ser identificadas. Un ejemplo muy claro es el del experto de la Universidad de Stanford Dennis Wall quien diseñó un algoritmo capaz de reconocer emociones y lo sincronizó con las Google Glass. Más de 100 niños con trastorno del espectro autista (TEA), un desorden neurológico que dificulta reconocer las emociones ajenas, lo probaron y lograron aumentar notablemente su capacidad para comunicarse con otros.

Y el rostro no es lo único que los algoritmos utilizan para saber quién es quién. Nuestra forma de caminar también es un medio para reconocernos. Un reciente estudio dirigido por Todd Pataky, de la Universidad de Shinshu (China) ha recurrido al análisis de la distancia de los pasos, la medida del pie, la forma de apoyarlo y otras variables (en total más de 10.000 puntos de datos) para predecir con un 99,6% de certeza, solo por su forma de caminar, a 104 personas.

Si unimos todo esto, rostros cubiertos, emociones, enfermedades genéticas, imágenes de espalda y forma de caminar, el potencial de los algoritmos para reconocernos casi no dejaría margen para el error.

El problema es que no se trata de técnicas infalibles. Ni tampoco de algoritmos cuyo objetivo no sea la discriminación. Varios ejemplos de los errores de estos sistemas son muy recientes. Uno de ellos está vinculado a la política de nudismo en las fotos de Facebook...y su censura a la famosa imagen de la niña del Napalm por «pensar» que se trataba de una fotografía de desnudos. El otro ejemplo tiene que ver con Google, cuyo sistema de reconocimiento facial identificó a dos afroamericanos como gorilas. Las cámaras de Nikon preguntaban si alguien había parpadeado cuando una persona de ojos rasgados aparecía en la imagen y un vídeo de un sistema de IA de Hewlett Packard se hizo viral al mostrar que reconocía y seguía a una mujer blanca pero no reconocía como humano a un afroamericano. Estos inconvenientes obedecen simplemente a la falta de información de los sistemas, basta sumarles más datos para que sean igual de efectivos. El problema es que estos pueden agregarse para discriminar y así prohibir la entrada a quienes tengan un color de piel diferente a cualquier recinto o discriminar en una solicitud de trabajo. En todo caso se trata del uso que le demos a estas herramientas, no de ellas. El experto en ética tecnológica David Polgar lo explica cuando afirma que «los ingenieros que diseñan algoritmos, por su propia naturaleza, están tratando de resolver un problema. Si alguien me dice que construya un cuchillo más afilado, solo pensaré en el filo. Mi objetivo es no pensar en todas las posibles maneras en que el cuchillo podría ser mal utilizado. Esa responsabilidad recae sobre los individuos de la compañía que decidieron que la herramienta debía ser más afilada y para qué la usarán».

El verdadero problema es cuando hay diseños cuyo objetivo es, como mínimo, sorprendente, teniendo en cuenta lo que es capaz de hacer. En este lugar se encuentra un nuevo algoritmo concebido por la Universidad de Stanford University, que puede señalar con una fiabilidad del 81%, la inclinación sexual de una persona viendo una fotografía. ¿Para qué querría alguien utilizar esto? Teniendo en cuenta que la homosexualidad es ilegal en más de 70 países, el uso de esta tecnología da mucho que pensar...al igual que su margen de error. El derecho a la privacidad, el abuso de estas tecnologías para discriminar en lo político, lo sanitario, lo profesional, son temas que se deben abordar de modo inmediato.

La conectividad, entre personas y objetos, está aumentando notablemente, al igual que la capacidad de procesar información proveniente de la red y la Nube. Y muy pronto todos llevaremos sistemas de reconocimiento facial en la mano (ver recuadro). Deberíamos saber para qué y cómo usarlos. Y también quién los usa con nosotros.

✕

Accede a tu cuenta para comentar