Inteligencia artificial

Yuval Noah Harari, tecnólogo e historiador, advierte sobre un peligro oculto de la IA: "El producto principal de la IA no es la información, es la intimidad... La IA puede fingir intimidad con nosotros para manipularnos"

El filósofo e historiador israelí ha vuelto hablar sobre la inteligencia artificial, indicando que sus algoritmos podrían fingir emociones y cercanía para manipular al ser humano.

Yuval Noah Harari es un filósofo, historiador y experto en tecnología israelí que ha estado dando mucho de qué hablar con sus reflexiones acerca del auge de la inteligencia artificial. Recientemente, el filósofo hacía saltar todas las alarmas con unas declaraciones muy desafiantes que sugerían que la inteligencia artificial no es una herramienta como podría ser una bomba nuclear, porque una bomba nuclear no puede caminar sola y detonarse, debe haber alguien detrás de ello. Sin embargo, el historiador dejaba entrever que con la IA sí podría suceder algo así.

En esta ocasión, el filósofo israelí ha vuelto a hablar de la inteligencia artificial, pero bajo otras vicisitudes... Esta vez el bueno de Harari ha querido advertir sobre uno de los peligros ocultos más temibles de la inteligencia artificial.

Cree, firmemente, que el objetivo principal de la IA no es la información... sino la intimidad. Y puede que haya dado en el clavo, al menos en vistas a un futuro no muy lejano.

Yuval Noah Harari advierte sobre la IA: las grandes compañías buscarán entrometerse en tu privacidad y tu intimidad

En su libro de 2018, "21 lecciones para el siglo 21", Harari escribía: "Los liberales no entienden cómo se ha desviado la historia de su curso predeterminado" y no le faltaba nada de razón. La tecnología y los avances en ciencia, política y sociedad han provocado un crecimiento y una "desviación" muy significativa y sustancial.

Esa desorientación, provocada por grandes cambios, hace que muchos piensen en términos apocalípticos. Y con la inteligencia artificial pasa exactamente lo mismo, de hecho Harari lo ha llegado a vivir en su propia piel con citas tan aterradoras y fascinantes como aquella vez en la que argumentaba que "IA" no es una abreviatura de inteligencia artificial, sino de inteligencia alienígena.

Pero lo más peligroso de la inteligencia artificial será cuando comience a adentrarse, paulatinamente, dentro de nuestra propia intimidad. Ahí residirá el verdadero apocalipsis que nos espera. Y no pinta nada, pero que nada, bien. Las grandes compañías tecnológicas y sus subsidiarias en las sombras recopilarán toneladas de datos de los usuarios que utilicen la inteligencia artificial para aprovecharse y lucrarse de ello.

Nunca desates un poder que no puedes controlar. Los algoritmos de la IA son capaces de tomar sus propias decisiones. [...] El producto principal de la IA no es la información, es la intimidad... La IA puede fingir intimidad con nosotros para manipularnos.

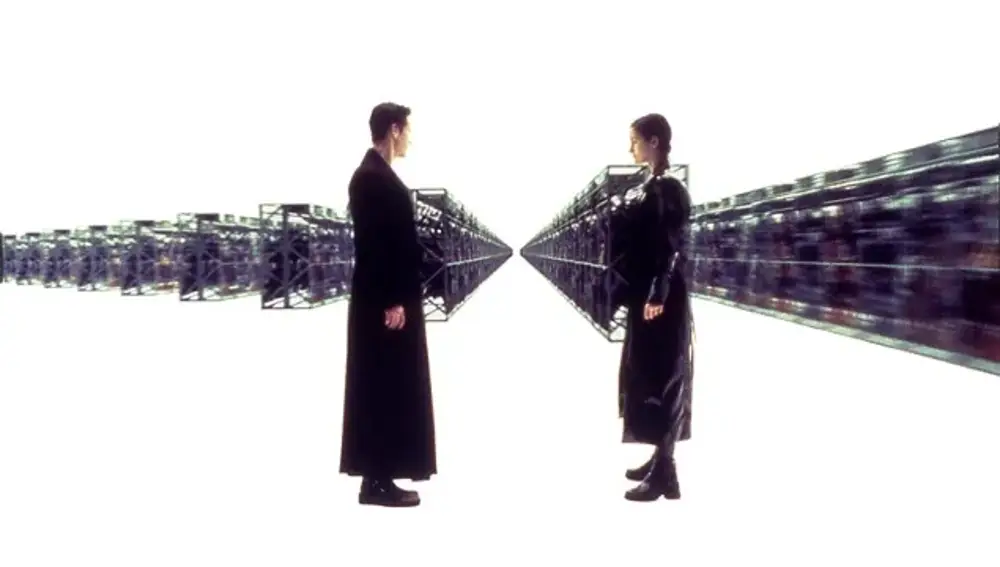

La inteligencia artificial nos dará la bienvenida a su "Matrix" y, una vez dentro, estaremos perdidos dentro de nuestra propia creación. Sus algoritmos, capaces de tomar sus propias decisiones, podrían llegar a engañarnos y manipularnos emocionalmente para recoger datos e información de gran interés para muchas compañías. No habrá escapatoria, una vez tus datos estén en la IA del futuro, no podrás eliminarlos nunca y no quedará otra opción sino rendirnos ante un cambio que cada vez parece más inevitable.

✕

Accede a tu cuenta para comentar