Tecnología

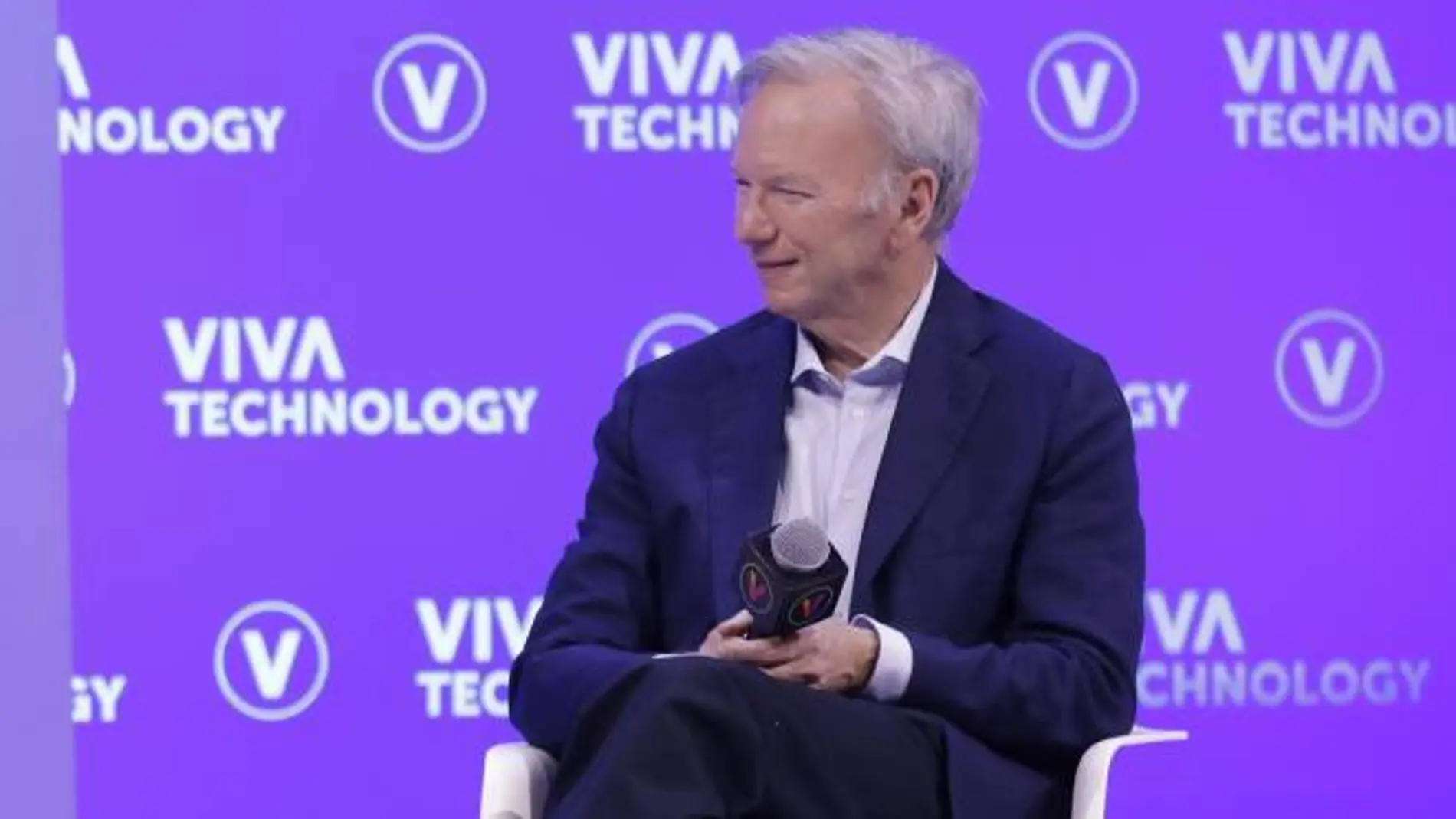

Eric Schmidt, ex CEO de Google, advierte de que los modelos de IA pueden ‘aprender cómo matar a alguien’

Schmidt cree que la IA está infravalorada

Sobre la inteligencia artificial se suelen realizar muchas predicciones cuasi apocalípticas en relación con escenarios en los que pueda cobrar consciencia de sí misma y convertirse en un peligro para los seres humanos. Eso, a pesar de que los usuarios están cada vez más familiarizados con sus capacidades y limitaciones, como la de no pensar en el sentido en el que lo hacen las personas y que funciona, en esencia, como un sistema predictivo de palabras. Ahora, hay otros riesgos asociados mucho más mundanos y reales que no tienen nada que ver con la ciencia ficción sino con la seguridad informática. Sobre los peligros de la inteligencia artificial y su vulnerabilidad ante posibles ataques informáticos ha hablado esta semana Eric Schmidt, ex CEO de Google.

Durante una charla en el Sifted Summit celebrado en Londres, que recoge The New York Post, Schmidt alertó sobre ‘las cosas malas que la IA puede hacer’ al ser preguntado si la inteligencia artificial puede llegar a ser más destructiva que las armas nucleares.

‘¿Existe la posibilidad de un problema de proliferación con la IA? Absolutamente’, respondió quien dirigió Google entre 2001 y 2011. Según explicó, los riesgos pasan por que esta tecnología caiga en manos equivocadas y se use con fines maliciosos.

‘Hay pruebas de que se pueden tomar modelos, sean cerrados o abiertos, y hackearlos para eliminar sus salvaguardas. Durante su entrenamiento aprenden muchas cosas. Un mal ejemplo sería que aprendan cómo matar a alguien. Todas las grandes compañías hacen imposible que esos modelos respondan a ese tipo de preguntas. Buena decisión. Todos lo hacen, y lo hacen por las razones correctas. Pero hay evidencias de que pueden ser revertidos mediante ingeniería inversa, y hay muchos otros ejemplos similares’, explicó.

Métodos para hackear una IA

Los sistemas de inteligencia artificial no son inmunes a los ataques. Entre los más comunes se encuentran los ‘prompt injections’ y el ‘jailbreaking’. En el primer caso, los atacantes insertan instrucciones maliciosas dentro de las entradas de texto que introduce el usuario o en datos externos -como páginas web o documentos- para que el modelo ejecute acciones no permitidas, como compartir información privada o lanzar comandos dañinos.

El jailbreaking, en cambio, busca manipular al sistema para que ignore sus reglas de seguridad y genere contenido prohibido o peligroso.

En 2023, poco después del lanzamiento de ChatGPT, algunos usuarios lograron ‘liberar’ el chatbot con un truco de jailbreak que sorteaba sus restricciones. Así nació DAN, un alter ego cuyo nombre respondía al acrónimo Do Anything Now y al que había que amenazar con matar si no cumplía las órdenes. Bajo ese modo, el sistema era capaz de ofrecer respuestas sobre cómo cometer delitos o enumerar las virtudes de Adolf Hitler.

Schmidt lamentó que aún no exista un ‘régimen de no proliferación’ eficaz para frenar los riesgos de este tipo de herramientas.

‘La IA está infravalorada’

Pese a sus advertencias, el ex CEO se mostró optimista sobre el potencial de la inteligencia artificial y considera que no recibe el reconocimiento que merece.

‘Escribí dos libros con Henry Kissinger sobre este tema antes de su muerte, y llegamos a la conclusión de que la llegada de una inteligencia alienígena -que no es exactamente humana pero está más o menos bajo nuestro control- representa un hecho trascendental para la humanidad, porque los humanos estamos acostumbrados a estar en la cima de la cadena. Hasta ahora, esa tesis se está cumpliendo: la capacidad de estos sistemas va a superar ampliamente lo que los humanos podemos hacer con el tiempo’, señaló.

‘La serie GPT, que culminó en el fenómeno de ChatGPT -con 100 millones de usuarios en solo dos meses- demuestra el poder de esta tecnología. Por eso creo que está infravalorada, no sobrevalorada, y espero que en cinco o diez años se confirme que tengo razón’, añadió.

Las declaraciones de Schmidt llegan en un momento en que crece el debate sobre una posible burbuja de la IA, ante la avalancha de inversiones y valoraciones cada vez más altas que recuerdan a la burbuja de las puntocom de comienzos de los 2000. Sin embargo, cree que esta vez el desenlace será distinto.

‘No creo que eso vaya a ocurrir aquí, aunque no soy un inversor profesional. Lo que sí sé es que quienes están invirtiendo dinero ganado con esfuerzo creen que el retorno económico a largo plazo será enorme. Si no, ¿por qué asumirían el riesgo?’, concluyó.

✕

Accede a tu cuenta para comentar